AI 쪽에 계속 혁신이 일어나나 보군요

2024.07.04 14:24

AI 학습시킬때 전기 소모가 많아 큰 문제라고 하더니

연구자들이 해결 방법을 찾아 내고 있나봅니다.

“10억 매개변수 LLM 실행에 전구용 13와트 전력이면 충분”

https://www.aitimes.com/news/articleView.html?idxno=161082

https://semiengineering.com/lower-energy-high-performance-llm-on-fpga-without-matrix-multiplication/

코드 https://github.com/ridgerchu/matmulfreellm

연구자들은 동일한 성능과 정확성을 유지하면서 신경망에서 행렬 곱셈을 제거하기 위해 두가지 방법을 결합했다.

먼저 행렬 내의 모든 숫자를 -1, 0, 1의 세 가지 값 중 하나로 변환했다.

이를 통해 숫자를 곱하는 대신, 더하는 방식으로 계산이 가능해졌다.

그다음 시간 기반 계산(time-based computation)을 도입해 네트워크에 효과적인 메모리를 제공,

더 적은 연산을 수행하면서 빠르게 동작할 수 있게 했다.

한 행렬의 모든 숫자를 다른 행렬의 모든 숫자와 곱하는 일반적인 방식 대신,

동일한 수학적 결과를 얻기 위한 전략을 개발했다 이 접근 방식에서는 행렬을 겹쳐 놓고 가장 중요한 연산만을 수행한다.

연구진은 "행렬 곱셈에 비해 상당히 가벼운 방법"이라며 "우리는 비용이 덜 드는 연산으로 비싼 연산을 대체했다"라고 설명했다

인간이 읽을 수 있는 처리량을 넘어 13W로 수십억 개의 파라미터 스케일 모델을 처리하여

LLM을 뇌와 같은 효율성에 더 가깝게 이동시켰습니다

또한

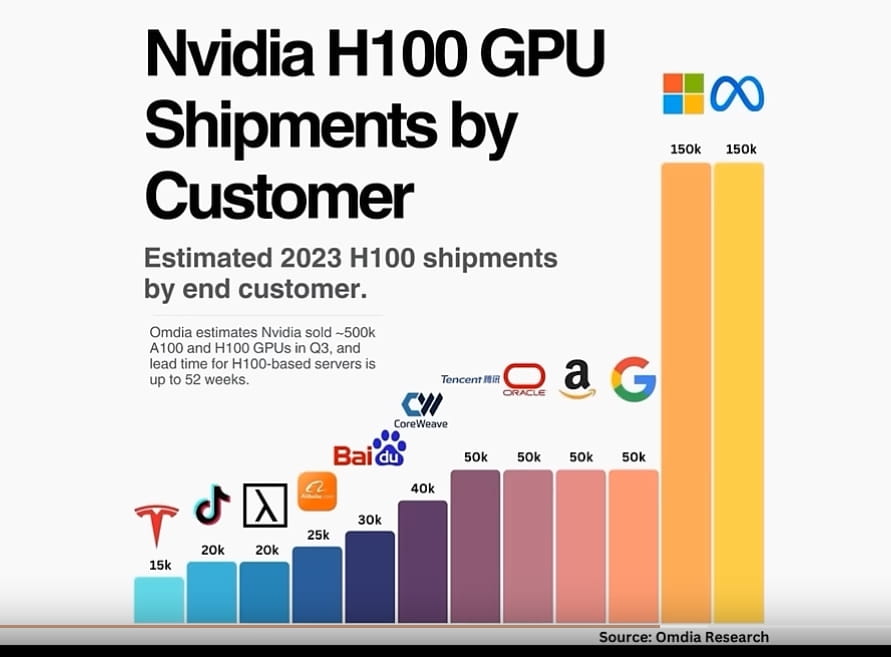

엔비디아의 GPU 하드웨어는 행렬 곱셈에 최적화되어 있기 때문에,

연구진은 소비 에너지를 더 줄이기 위해 신경망에 최적화된 맞춤형 하드웨어를 설계했다.

연구진은 FPGA라는 프로그래밍 가능한 회로 위에 맞춤형 하드웨어 프로토타입을 개발했다.

-내용중-

출처 : AI타임스(https://www.aitimes.com)

차세대 뉴로모픽

https://www.kaist.ac.kr/news/html/news/?mode=V&mng_no=37670

AI 사피엔스 최재붕교수 세바시

AI와 인간두뇌 :변화 할수 있는사람 없는사람

AI에 인격 입힌 '페르소나 챗봇', 킬러 서비스될 수 있을까?

https://youtu.be/QQ15UFm61GI

AI 격차정리

미래가치

우리가 생각하고 있는것보다 더 심각하게 AI의 잠식 속도가 높더군요.